By Isaac Milan, Cybersecurity Consultant

La palabra deepfake se forma por la conjunci√≥n de las palabras inglesas ¬Ђdeep learning¬ї, aprendizaje profundo, y ¬Ђfake¬ї, que significa falso. Los deepfakes son videos, im√°genes o archivos de voz manipulados y producidos con inteligencia artificial (IA, por su desarrollo en ingl√©s artificial intelligence), que tienen una apariencia altamente realista. Con la ayuda de algoritmos de IA se logra analizar y replicar ciertos patrones de personas como la voz, gestos y expresiones faciales, a tal grado que parece que est√°n expresando o haciendo cosas realmente verdaderas pero que nunca ocurrieron. ¬†Aunque los deepfakes han permitido la creaci√≥n de contenido innovador para ciertas industrias, tambi√©n han planteado desaf√≠os de seguridad cuando se utilizan de manera indebida.

Así, los deepfakes se han vuelto populares en las redes sociales, plataformas de noticias y el entretenimiento. Dada su tendencia a alterar las percepciones, se han utilizado en la creación de videoclips humorísticos y parodias. Los deepfakes utilizan técnicas creativas en el cine y logran producir diversos efectos, como rejuvenecer a actores o recrear a aquellos ya fallecidos en nuevas películas.

No obstante, tambi√©n se utilizan en escenarios m√°s serios y peligrosos, como videos con motivaciones pol√≠ticas, para causar alg√Їn tipo de desinformaci√≥n o estafas por Internet, como, por ejemplo, en videos manipulados de figuras pol√≠ticas que pueden alterar la opini√≥n p√Їblica o interferir en elecciones. Finalmente, en el periodismo, los deepfakes pueden ser usados para simular eventos o recrear discursos de figuras hist√≥ricas y, en este sentido, plantean riesgos significativos por su mal uso.

Cómo se crean los deepfakes

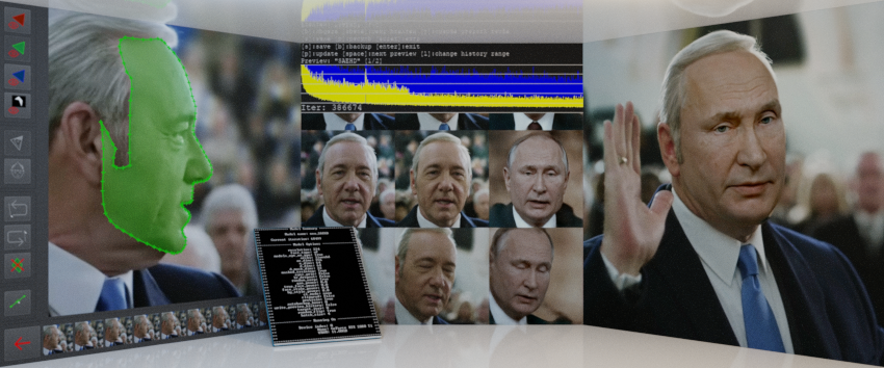

Para crear un deepfake se requiere recolectar una gran cantidad de datos visuales y auditivos de la persona a imitar como, por ejemplo, imágenes y videos para analizar sus características faciales, gestos y voz. Enseguida, utilizando algoritmos de aprendizaje profundo, especialmente redes neuronales convolucionales (CNN, por su desarrollo en inglés convolutional neural network) y redes generativas antagónicas (GAN, por su desarrollo en inglés generative adversarial networks), estos datos se procesan para entrenar un modelo que pueda generar el contenido falso. Este modelo aprende a replicar y combinar las características de la persona, para crear así un video, imagen o clip de audio que parece real, pero que es completamente artificial. La calidad del deepfake creado depende directamente de la cantidad y la calidad de los datos de entrada y de la capacidad del modelo para aprender de estos datos.

Figura 1. Impacto de los deepfakes en la seguridad: manipulación avanzada de imágenes y desafíos para la verificación de identidad.

Asimismo, el costo econ√≥mico de la creaci√≥n de deepfakes utilizando redes generativas antag√≥nicas (GAN) ha disminuido debido a los avances en los hardware y software, que han hecho m√°s accesibles los recursos computacionales necesarios. Adem√°s, la disponibilidad de herramientas y plataformas de c√≥digo abierto junto con las mejoras en la eficiencia de los algoritmos de IA ha reducido significativamente la barrera de entrada para crear deepfakes de alta calidad. Estos factores han permitido que la creaci√≥n de deepfakes sea m√°s econ√≥mica y accesible para un mayor n√Їmero de personas.

Los recientes avances tecnológicos hacen posible que cualquier persona con un ordenador pueda crear deepfakes. El código de fuente abierta, las aplicaciones móviles gratuitas, los tutoriales en línea y los proveedores de servicios de IA de bajo costo han ampliado enormemente el acceso a las herramientas necesarias.

Figura 2. Herramienta DeepFaceLab ¬Ђhttps://github.com/iperov/DeepFaceLab¬ї para la creaci√≥n de deepfakes accesible para el p√Їblico.

Impacto de los deepfakes

Los deepfakes ofrecen oportunidades muy relevantes en áreas como el marketing digital, el cine, la educación y la comunicación personal. Sin embargo, cuando los deepfakes se utilizan para crear desinformación y manipular los hechos de una situación, representan un problema, ya que alteran las realidades políticas y sociales.

Con el avance de la IA, la creaci√≥n de deepfakes ha evolucionado y pas√≥ de ser una t√©cnica compleja y costosa a una m√°s accesible, aumentando la facilidad con la que se los puede crear y difundir. Los futuros desarrollos prometen deepfakes a√Їn m√°s indistinguibles de la realidad, lo que podr√≠a tener implicaciones tanto innovadoras como problem√°ticas, como podr√≠a ser la suplantaci√≥n de identidad.

Seg√Їn Kaspersky, se calcula que hay m√°s de 15¬†000 deepfakes publicados en este momento. Algunos solo pretenden ser divertidos, pero otros intentan manipular las opiniones del espectador. Sin embargo, ahora que solo se tarda uno o dos d√≠as en crear un nuevo deepfake, esta cifra podr√≠a aumentar muy r√°pidamente.

Independientemente del tipo de deepfake utilizado, video, audio o incluso imágenes estáticas, el fraude de deepfake utiliza en gran medida la tecnología para permitir al estafador hacerse pasar por otra persona. Una vez manipulada la voz o la imagen de la víctima, el estafador le indicará que transfiera dinero a su cuenta o que realice otros movimientos cuestionables.

Seg√Їn el Dr. Nasir Memon, profesor de inform√°tica e ingenier√≠a de la escuela New York University Tandon School of Engineering, citado por Mathieu Miller, la prevalencia de los deepfakes va en aumento, incluido el desarrollo de oportunidades de Deepfake-as-a-Service para los ciberdelincuentes.

Como resultado, los delincuentes están viendo un gran salto adelante en su capacidad para cometer fraudes, extorsionar por grandes sumas de dinero, dañar reputaciones e incluso perturbar la seguridad nacional. Por ejemplo, la IA se utiliza ahora para alterar mapas, imágenes y radiografías, generar texto e incluso crear obras de arte realistas. Asimismo, los avatares digitales generados por IA son cada vez más capaces de mantener conversaciones, mostrar emociones y hacer gestos humanos realistas.

De hecho, este tipo de fraude cuenta ya con varios antecedentes destacados. Por ejemplo, el caso de un director general que fue convencido por una voz falsa creada mediante clonación de voz para que transfiriera 240 000 dólares a un proveedor que no conocía, en un país diferente.

Riesgos y amenazas

- Cometer delitos relacionados con la integridad, la imagen o el fraude.

- Propagar noticias falsas.

- Generar desinformación.

- Desacreditar a alguien.

- Llevar a cabo venganzas.

- Manipular los mercados financieros.

- Influir en las votaciones o toma de decisiones o pensamiento grupal.

Protección ante los deepfakes

En la actualidad los deepfakes audiovisuales a√Їn presentan imperfecciones que pueden ser identificadas a simple vista. Para detectar estas caracter√≠sticas en los videos, se debe estar atento a ciertos indicadores:

- Movimientos bruscos o poco naturales de los personajes.

- Cambios repentinos en la iluminación de un fotograma a otro.

- Variaciones inusuales en el tono de piel de los personajes.

- Parpadeo irregular o la completa ausencia de este.

- Descoordinación entre el movimiento de los labios y el sonido del habla.

- Presencia de artefactos digitales o distorsiones en la imagen.

Sin embargo, los deepfakes se vuelven cada vez m√°s sofisticados, por lo que futuras contramedidas por parte de la comunidad de ciberseguridad, de los gobiernos y de las personas ser√°n necesarias, como las siguientes:

- Uso de la IA: crear algoritmos que puedan identificar autom√°ticamente alteraciones en audio y video.

- Legislaciones: implementar nuevas legislaciones para regular o prohibir la creación y distribución de contenido de deepfake diseñado para engañar.

- Educación: educar sobre los deepfakes para ayudar a las personas a discernir contenido auténtico del falso.

Bibliografía

Kaspersky. (s. f.). Videos falsos y deepfake: ¬њc√≥mo pueden protegerse los usuarios? https://latam.kaspersky.com/resource-center/threats/protect-yourself-from-deep-fake

Mathieu Miller. (2023). Deepkakes: Real threat. https://kpmg.com/kpmg-us/content/dam/kpmg/pdf/2023/deepfakes-real-threat.pdf